Model

Un Model, in Alida, raccoglie metadati e file implementanti un modello di machine learning.

Gestione dei Model

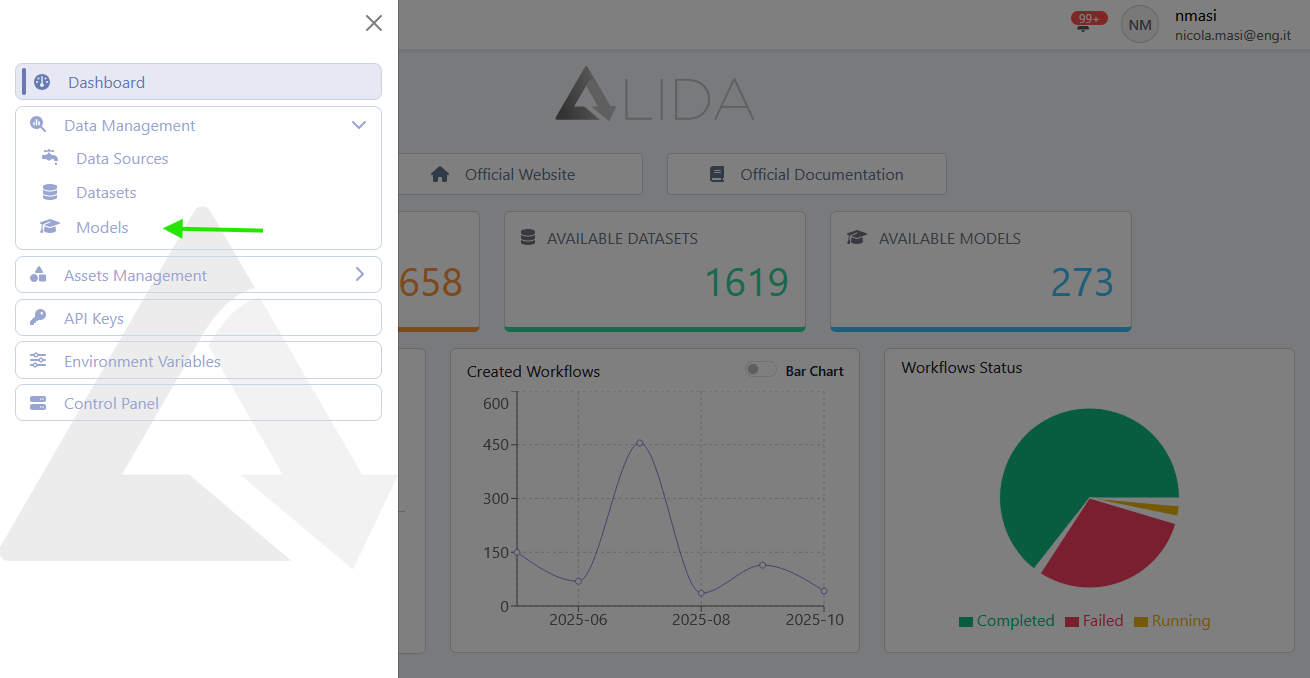

La pagina di gestione dei Model è raggiungibile dal menù laterale:

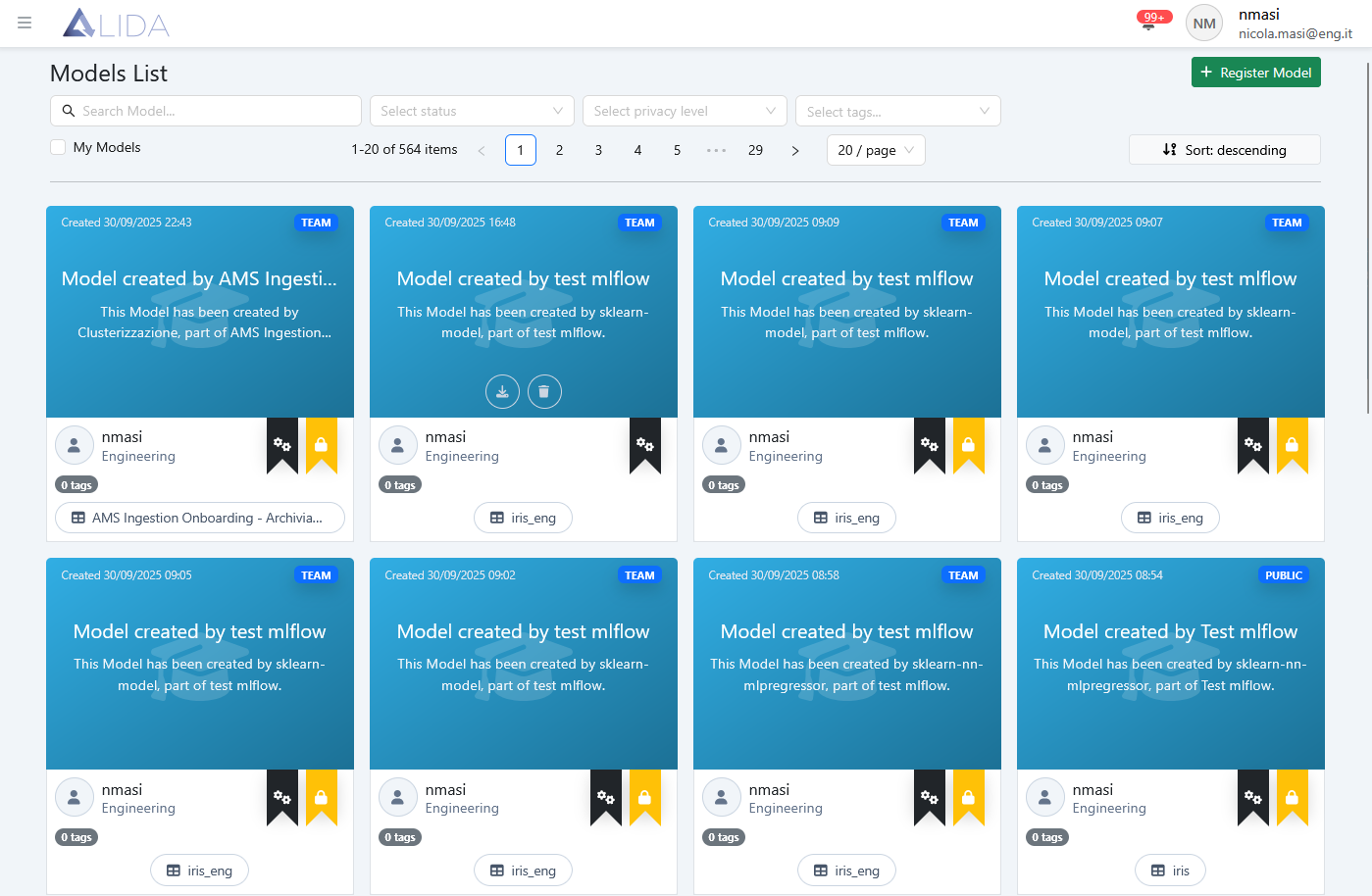

Da lì è possibile visualizzare l'elenco dei Model presenti a catalogo:

Qui, dalla barra superiore, è possibile:

- Cercare i Model per parole chiave

- Filtrare i Model per stato

- Virtual (

)

) - Created

- Virtual (

- Filtrare per livello di Privacy

- Filtrare per tags

- Ordinare e cambiare pagina

- Accedere al form di registrazione Model

Inoltre, dalla card di ciascun Model è possibile accedere alle seguenti funzioni:

Scaricare il Model sul computer locale

Eliminare il Model

Registrazione nuovo Model

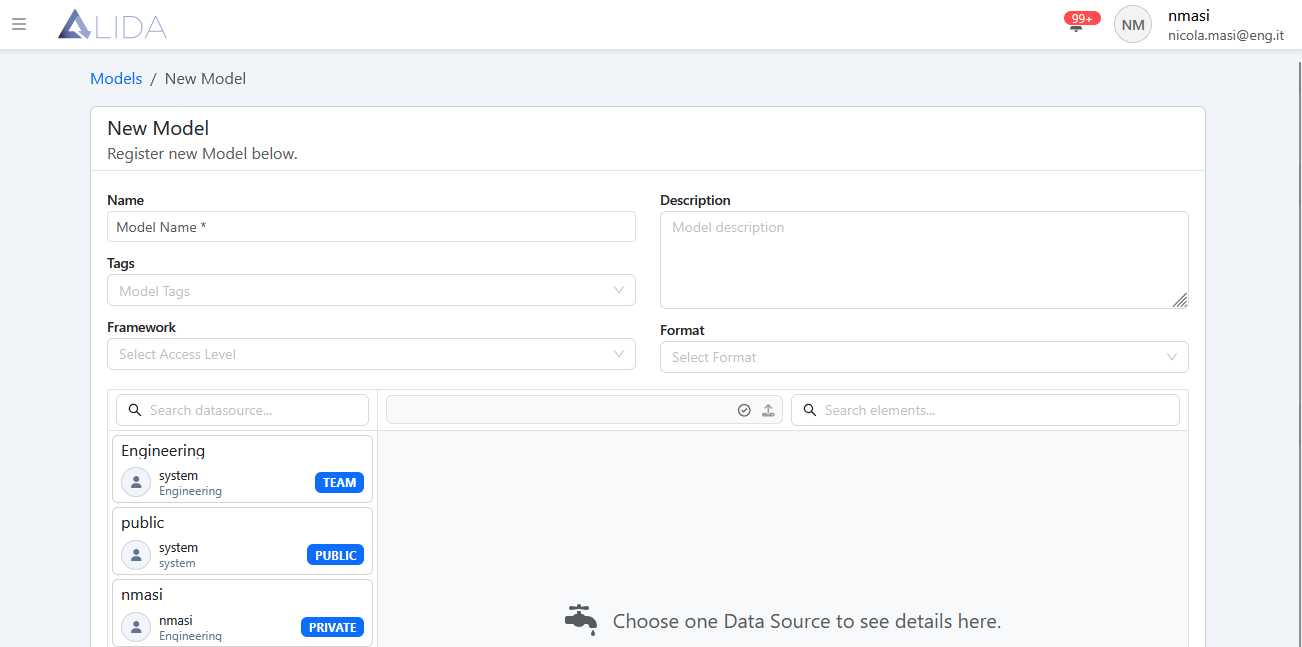

Per registrare un nuovo Model clicca su + Register Model dalla pagine di gestione dei Model si aprirà il form di registrazione:

A questo punto la procedura è del tutto analoga a quanto visto durante il Quickstart per il caricamento di un Dataset (vedi Caricamento Dataset nel Quickstart)

L'unica differenza sta nel fatto che qui si potrà anche selezionare il formato del Model da caricare.

I formati supportati sono i seguenti:

| format (Alida) | Framework / uso | implementation in model-settings.json |

parameters.uri (cosa punta) |

Note principali | Documentazione |

|---|---|---|---|---|---|

| SKLearn | Modelli scikit-learn serializzati (joblib/pickle) | mlserver_sklearn.SKLearnModel |

File modello: es. ./model.joblib o ./model.pkl |

Modelli sklearn tabellari salvati via joblib/pickle. | https://github.com/SeldonIO/MLServer/tree/master/runtimes/sklearn |

| XGBoost | Modelli XGBoost | mlserver_xgboost.XGBoostModel |

File modello: es. ./model.json o ./model.bst |

Modelli salvati con API XGBoost (save_model). |

https://github.com/SeldonIO/MLServer/tree/master/runtimes/xgboost.html |

| LightGBM | Modelli LightGBM | mlserver_lightgbm.LightGBMModel |

File modello: es. ./model.txt / ./model.bst |

Artefatti esportati con Booster.save_model. |

https://github.com/SeldonIO/MLServer/tree/master/runtimes/lightgbm.html |

| MLFlow | Modelli salvati o registrati con MLflow | mlserver_mlflow.MLflowRuntime |

Directory MLflow, es. ./model oppure models:/MyModel/1 |

Usa la cartella MLflow (MLmodel, environment, ecc.). |

https://github.com/SeldonIO/MLServer/tree/master/runtimes/mlflow.html |

| HuggingFace | Modelli/pipeline HuggingFace Transformers | mlserver_huggingface.HuggingFaceRuntime |

Non sempre necessario; spesso configurati via extra | Per NLP/LLM; configurazione via parameters.extra. |

https://github.com/SeldonIO/MLServer/tree/master/runtimes/huggingface.html |

| Spark Mlib | Modelli Spark MLlib | mlserver_mllib.MLlibModel |

Path a pipeline salvata da Spark MLlib | Carica pipeline esportate tramite model.write().save. |

https://github.com/SeldonIO/MLServer/tree/master/runtimes/mllib.html |

| Python | Modelli custom in Python | Es. mlserver_python.PythonModel o tua sottoclasse |

Directory con codice Python + eventuale file modello | Permette di implementare load() e predict() manualmente. |

https://github.com/SeldonIO/MLServer/tree/master/runtimes/python.html |

| MLServer | Catch-all per runtime generici (Tempo, Alibi, custom) | Dipende dal runtime desiderato | Directory con artefatti del runtime (Tempo, Alibi, ecc.) | Usato per runtime non coperti sopra. | https://github.com/SeldonIO/MLServer/blob/master/docs/user-guide/custom.md |